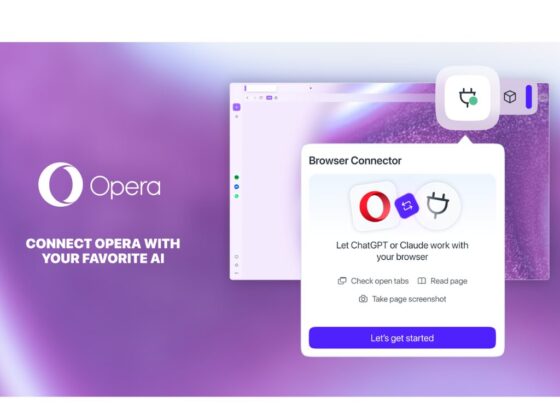

Yapay zekanın (AI) çeşitli kullanım alanları giderek genişliyor. AI, okul ödevlerinden New York metrosunda silah tespitine kadar birçok alanda kullanılıyor. Ancak, deepfake teknolojisi kullanarak çocuk cinsel istismarı içeriği üreten suçluların mahkumiyetinde de AI’nin rolü dikkat çekiyor. ESET, yapay zekanın yanlış yöne gitmesini önlemek için alınması gereken önlemleri inceledi.

ESET, yapay zekayı güvenlik alanında kullanıyor, ancak AI’nin her zaman doğru sonuçlar vermediği konusunda uyarılarda bulunuyor. Yanlış pozitifler ve gözden kaçan tehditler, güvenlik ekiplerinin iş yükünü artırabilir. Bu nedenle, ESET yapay zekayı diğer teknolojilerle katmanlandırarak denge sağlıyor.

Yapay zeka, kimlik avı ve sosyal mühendislik saldırılarında kullanılabilir. Kötü niyetli aktörler, AI’yi kullanarak kimlik doğrulama sistemlerini aldatabilir. Bunu önlemek için çok faktörlü kimlik doğrulama (MFA) kullanılmalıdır. MFA, saldırganların sadece bir yöntemle yetinmeyip, birden fazla kimlik doğrulama adımını geçmesini gerektirir.

Yapay Zekanın Sorumluluğu

AI’nin hatalı kararlarının sonuçları tartışmalı bir konu. AI destekli sürücüsüz bir araba kaza yaparsa sorumluluk kime ait olacak? Bu tür sorular, yapay zekanın fiziksel zarar verme yeteneği arttıkça daha da önem kazanıyor.

Gizlilik ve Yasal Düzenlemeler

GDPR kuralları, yapay zekanın kötüye kullanılmasını engellemede önemli bir rol oynuyor. Ancak, yapay zekanın ürettiği içeriklerin gizlilik ihlali olup olmadığı tartışmalı. Örneğin, gazeteciler Microsoft ve OpenAI’ye, makalelerin izinsiz kopyalanması nedeniyle dava açtı. Bu davalar, gelecekte yapay zeka ile ilgili yasal düzenlemeler için örnek teşkil edebilir.

Yapay zeka büyük güç ve sorumluluk getirir. AI sağlayıcılarının, yapay zekanın kötüye kullanımı durumunda daha sorumlu hareket etmeleri gerekiyor.